易翻译在多数日常场景下对英语口音的识别是比较可靠的:常见的美式、英式发音在安静、清楚的输入下往往能被正确识别,但遇到强烈的非母语口音、方言变体、快速语速或明显背景噪声时,识别准确率会显著下降,用户体验也会随设备、网络和句子复杂度产生较大差异。

先把“口音识别”拆开来讲——像在教别人一样

把口音识别想象成两个步骤的活儿:先“听懂”(把声音变成文字),再“判定/翻译”(把文字映射到标准表达或另一种语言)。这就像先把一道方程里的数字抄下来(听成文字),再把方程解出来(翻译成目标语言或判断口音)。如果抄错了数字,接下来的结果肯定也会错。

关键术语,简单解释

- ASR(自动语音识别):把语音变成文字的部分,口音识别的第一道关。

- 口音分类/识别:不只是写出词,还要判断说话人属于哪种口音(比如美式、英式、印度式英语等)。

- WER(词错误率):衡量识别错误的常用指标,数字越小越好。

- 噪音鲁棒性:在背景噪声下还能不能听清楚的能力。

影响“易翻译”英语口音识别准确性的因素

准确性不是单一标准,它受很多东西影响。下面把每个因素像拆礼物一样一项项展开:

1. 训练数据(模型见过什么口音)

模型更擅长它“见过”的口音。想象一个只见过美国人和英国人的老师,碰到印度腔或非洲腔就可能听不太懂。同理,如果易翻译后端模型的训练数据覆盖广、数量大,尤其包含非母语说话者的样本,就更能适应各种口音。

2. 声学模型与语言模型

声学模型负责把声音映射成音素或词;语言模型负责判断哪些词序列更合理。即使声学层把近似音识别出来,语言模型会用上下文“修正”结果,这对短句或孤立词尤其重要。

3. 设备与录音质量

- 手机麦克风、耳机麦克风、外接麦克风的拾音差别大。

- 网络质量(云端识别会受影响),离线模型受设备算力限制。

4. 说话人的发音特征

包含语速、连读、吞音、重音位置、母语干扰(比如中文母语者把“v”读成“w”),这些都会改变识别结果。

5. 环境噪声与说话距离

嘈杂的咖啡厅、车内噪声或多人同时说话都会降低识别率,尤其是高频细节被掩盖时。

用生活化的类比理解误识别:为什么“I went to”会变成“I want to”

这其实是因为两句话在声音上非常相似(连读与弱读导致音节重叠),就像两张主色相近的照片被快速拍下,细节模糊后很难分辨。语言模型会根据常见搭配来“猜”哪个更合理,有时候这个猜测就是错的。

如果你想知道易翻译“准不准”,可以自己做个小实验——一步步教你验收

下面给出一个可重复的测试流程(越系统越接近真实客观结论),你可以用它来评估易翻译或其他翻译软件的口音识别能力。

测试准备

- 选择代表性说话者:至少包含美式、英式、澳式、印度式、非洲若干种变体以及中国英语(中式发音)等,最好每类至少两人。

- 采集样本:准备三个长度级别——短句(3–6词)、中长句(10–15词)、长句(20词以上)。

- 录制环境:静音室、普通室内和嘈杂环境各一组,每位说话者每种句子都录一次。

- 设备:手机内置麦克风、耳机麦克风、外接麦克风(如果可能)。

测量指标(不要只看对不对)

- W ER(词错误率):(替换数 + 插入数 + 删除数)/ 参考词数。

- 识别率(字面准确率):正确转写的句子占比。

- 意思保留率:即使有少量文字错误,翻译是否仍保留原意(主观评判,可打分)。

- 口音分类准确率:如果应用同时给出口音标签,记录标签正确的比例。

示例测试表(你可以复制保存)

| 说话者/口音 | 句子样例 | 环境 | 设备 | WER | 意思保留率 |

| 美式(General American) | “Could you tell me how to get to the central station?” | 静音室 | 手机 | 示例填写 | 示例填写 |

| 印度式 | “I have completed the assignment yesterday evening.” | 普通室内 | 耳机麦 | 示例填写 | 示例填写 |

| 中式英语(中国母语) | “Please sign here and hand me the document.” | 嘈杂环境 | 手机 | 示例填写 | 示例填写 |

怎样读这些结果——怎么判断“准”或“不准”

其实很简单:看三个层面。

- 字面层面(WER):如果WER低于10%(安静环境、短句),可以说“识别很好”;对长句或嘈杂环境,能保持20%以下已不错。

- 语义层面(意思保留):即便WER略高,但原话意思保留、关键实体无错,那就对使用来说是可接受的。

- 口音分类层面:大多数用户其实不关心分类标签,只要翻译准确就行;但如果你需要准确标注口音,这要求更高。

针对易翻译用户的实用建议(马上可用)

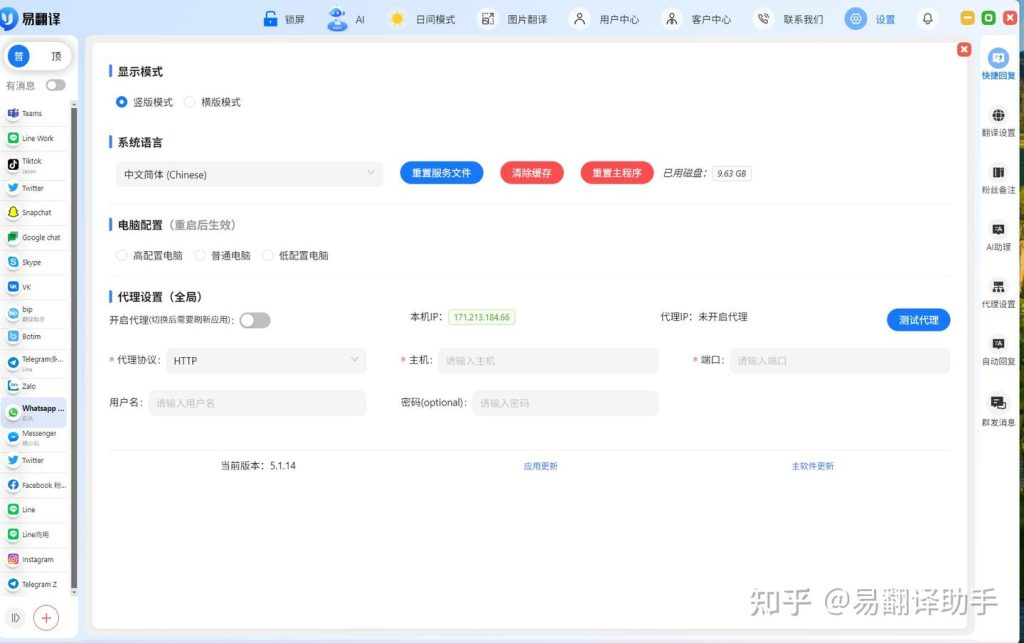

- 选择正确的语种/方言选项:如果应用允许选择“English (US)”或“English (UK)”,手动选择会提高识别率。

- 短句分割:尽量用短句或停顿清晰表达,长串句子容易累积错误。

- 降低背景噪音:靠近麦克风或换到安静处,或者使用带降噪的耳机。

- 说慢一点,清晰一点:对非母语者尤其有效,比不停纠结发音更实际。

- 更新应用与模型:新版往往包含更广的训练样本和优化。

常见误解,顺带澄清几条

- 误解一:“某款翻译APP识别不到我的口音,说明它差”——不一定,先看语速、噪声、句子长度和是否选对方言。

- 误解二:“离线一定比云端差”——离线受限于模型体积,但在隐私、延迟方面有优势;云端更新快、模型大,通常更稳。

- 误解三:“口音识别是公平的”——现实中训练数据偏向某些口音(如美式、英式),不公平性确实存在,厂商也在改进。

你可能还关心的几个技术小点(不深奥,易懂为主)

两个技术机制会反复影响效果:噪声抑制和自适应学习。噪声抑制相当于把手机当作“更聪明的耳朵”,试图把有用声音从噪声里抠出来;自适应学习就是系统“记住”你的发音习惯,时间久了会提高准确率(如果应用支持个性化模型的话)。

举个具体例子说明为什么个性化有效

你和我都说“water”,但你可能把/t/几乎不爆破,我则清晰发/t/。通用模型可能更偏向常见发法,但如果系统记住你习惯的发音(例如通过纠错记录),下次遇到相似发音就能更准确。

如果你要评价易翻译:一份可复制的评估清单

- 准备多口音、多噪声、多设备的录音样本(见上表)。

- 在安静/普通/嘈杂三种环境分别测试短句、中句、长句。

- 记录WER、意思保留、响应时延(实时翻译时非常重要)。

- 注意是否有口音选择、个性化设置、以及是否能导出识别日志以便分析。

这样子想想,还有很多小细节会影响感受:比如交互界面提示是否清楚、是否能手动纠错并让系统学习、翻译结果是否保留原文语气——这些统统影响“感觉上的准确”。顺着这些点去试一试,就能得到比单纯听口碑更靠谱的结论。祝你测试愉快,遇到哪种特殊口音有意思可以再聊聊交流经验。