易翻译获取结果的流程是:先对输入(文本、语音或图片)做识别和预处理,然后调用翻译模型做句法与语义分析,生成候选译文并打分排序,最后返回最终译文并提供发音、双语对照、原文回溯与修正建议,用户可选择复制、收藏或发起人工反馈。机器翻译结合神经网络与规则,优化术语与口语处理,并利用上下文提升文本连贯性和错误检测。

先把整体流程说清楚——像讲给朋友听

想象你把一句话交给一位懂多国语言的朋友,他要做几件事:听清楚(或看清楚)、弄懂意思、在脑子里把意思换成另一种表达、然后说出来或写出来。易翻译的“取结果”其实就是把这几步电子化、自动化:识别 → 理解 → 翻译 → 呈现。下面我按费曼法把每一步拆开,说清楚怎么做到的、为什么会有延迟或误差,以及作为用户你能看到和做什么。

四个核心步骤(简洁版)

- 识别(输入端):文本直接读取,语音要做语音识别(ASR),图片要做光学字符识别(OCR)。

- 预处理:清洗、分句、分词或子词切分,处理标点、数字、表情等特殊符号。

- 翻译引擎:模型(如基于Transformer的神经机翻)把源语言表示为向量,再生成目标语言候选译文,通常会做候选排序和打分。

- 渲染与后处理:显示最终译文、提供发音(TTS)、双语并列、保存和反馈选项,有时还会做格式保留和术语替换。

技术细节:每一步到底怎么取到结果

下面把每一步慢慢拆开来讲,尽量不用太多术语,但也不含糊。

1. 识别——输入是怎样变成“可读”的

你说一句话,手机先把声音变成一串数字,系统的语音识别(ASR)会把声音转成文字(即转录)。你拍张图,OCR会把图像上的字符识别出来。文本输入就直接进入下一步。识别的质量直接影响最后译文:听错、识别错或OCR漏字,翻译自然错得离谱。

2. 预处理——让机器“更好理解”你的句子

机器要处理的是“符号”,它会做这些事:

- 分句、分词(或做子词piece分割,比如BPE)

- 处理数字、货币、时间和特殊符号(把它们标准化)

- 归一化大小写、简繁转换或标点修正

- 如果是对话场景,会把上下文(前一句、前几句)拼接进去

这些看似“细碎”的事很重要——就像把原料切好,后面下锅才容易做出味道来。

3. 翻译引擎——核心:模型如何产生候选译文

现代系统多以神经网络(Transformer)为主。简单比喻:模型先把句子压成一串“语义向量”(就是抽象的意思),然后一步步“解码”成目标语言。常见流程有:

- 编码:把源句表示成向量序列。

- 解码:生成目标词,一个词一个词地预测(有时会并行或半并行)。

- 搜索策略:用Beam Search生成多个备选译文(n-best),并给每个备选打分。

- 后处理:恢复数字、专有名词,或把占位符替换回去。

4. 渲染与输出——把结果展示给你

最后一步系统会把“最终译文”呈现出来,并且通常会提供:

- 发音(点击朗读)

- 双语并列(原文与译文并排)

- 候选译文或翻译替代(你可以点开看n‑best)

- 复制、收藏、分享或提交反馈按钮

举个例子:你用语音翻译功能时发生了什么

一步步来:你按下“说话” → 手机录音包发送到服务器(或本地模型处理) → ASR把语音转文本 → 翻译模型把文本翻译 → 系统把译文返回并播放TTS。如果是实时对话,系统会边识别边翻译(流式ASR与流式翻译),允许较低延迟但可能先给出部分结果,后面再修正。

实时与非实时的区别(为什么你看到“先翻译后改进”)

- 实时流式:先返回部分译文(低延迟),随着更多音频或上下文,系统会更新译文。

- 离线/全文翻译:先等完整语句或段落,然后给出更连贯的译文(延迟高但质量通常更好)。

系统如何“取”最终哪一个译文?排序与置信度

翻译器通常不会只产生一个版本,而是生成若干候选并评分,最后挑出一个“最好”的。评分考虑语言流畅度、与源义的对齐、术语一致性等。系统还会给出置信度分数(confidence),用于:

- 决定是否显示翻译建议或提示“翻译可能不准确”

- 在对话中作为回退机制(低置信度时可能请求用户确认或显示多候选)

常见的输出形式(用户能看到的)

- 最终译文(主视图)

- 候选列表/可选译法(n‑best)

- 并列显示(原文 + 译文)

- 音频(TTS)

- 术语高亮与原文回溯

一个小表格:核心模块一览

| 模块 | 作用 | 常见技术 |

| 输入识别 | 把语音/图片/文本转成可处理的文本 | ASR、OCR、文本解析 |

| 预处理 | 清洗、分词、处理占位符 | BPE、正则、规则库 |

| 翻译模型 | 将源语言映射为目标语言候选 | Transformer、Seq2Seq、混合规则 |

| 后处理 | 格式化、术语替换、TTS | 词典、语音合成 |

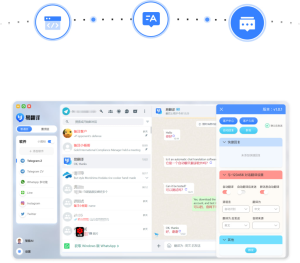

常见场景:文本、语音、拍照、对话,结果是怎么取到的

文本输入

最直接:用户输入→预处理→翻译→展示。你还能看到多译法和复制按钮,通常这是延迟最短、最稳定的场景。

语音实时互译

语音先做ASR(流式或非流式),ASR输出提交给翻译模型,翻译结果可能是增量的(实时显示片段)或最终的完整句子。用户会看到“听写文字”和“翻译文字”两处更新,点击可以让我朗读或复制。

拍照取词翻译

图片上传后先由OCR提取文字,再走翻译流程。OCR的准确率受字体、光照、角度影响。如果遇到表格或混合语言,系统会尽力分段并对应翻译(但复杂布局可能需手动校对)。

双语对话翻译

这更像两套流水线交替工作:A说→ASR→翻译→TTS播放给B,B说→ASR→翻译→TTS播放给A。系统常常在后台维护会话上下文,以便使译文连贯且保持对话主题。

影响结果的关键因素(也就是为什么翻译有时好有时差)

- 输入质量:噪声的语音、模糊的图片或错别字会直接导致错误。

- 上下文长度:短句容易,但长段落或长上下文需要更多内存与上下文建模。

- 术语/领域:专业术语若无词表支持,系统可能直译或找到错误替代。

- 模型能力与训练数据:数据里是否包含该语言对、口语化表达和特定领域内容。

- 网络/本地模式:云端模型通常更强但需联网;本地离线模型低延迟但能力受限。

用户可见的功能与交互(你能做什么来“取到更好结果”)

- 选择或确认源语言(自动检测不是100%准确)

- 在拍照或语音后检查识别结果,必要时手动修正再翻译

- 查看候选译文或历史记录,选择更合适的译法

- 添加自定义术语或短语表,提高专业翻译一致性

- 使用“反馈”或“修改并提交”功能,帮助系统学习(很多产品会用这些反馈做持续优化)

小技巧(实际好用)

- 短句优先:复杂长句可以拆成几句再翻译,质量往往更好。

- 关键词用大写或引号标注(在某些场景能保留专有名词格式)。

- 拍照对齐文字方向和保证光线,OCR成功率高很多。

- 遇到不确定时看置信度或多候选,别盲目复制粘贴。

评价与改进:系统如何自我提升(一点点背景)

易翻译之类的系统会用历史交互数据、人工标注、以及用户反馈来持续训练。常用的评估指标有BLEU、METEOR、chrF(这些是研究和工程常用的参考)。另外,人工后编辑数据能显著提升专业领域的表现(WMT比赛里常见做法)。如果你对某类文本要求高,上传少量高质量对照(术语表、范例句)能帮助定制化模型更快适配。

出现问题怎么办:常见问题解答(边写边想)

Q:为什么看到多个译文?

A:模型会给出多个候选(n‑best),因为语言本身有很多表达方法。系统通常选评分最高的一条作为默认,但你可以手动选择更符合语境的版本。

Q:翻译明显不对怎么处理?

A:先检查ASR/OCR是否有误;其次看看有没有专有名词被拆分或替换;最后用“反馈”或“修改并提交”把正确译文提交给系统,或者复制译文到别处做人工润色。

Q:能否离线使用并且取到结果?

A:部分功能支持本地模型(特别是常用语言对和短文本),结果会比云端模型略逊一筹,但能在无网环境下得到即时翻译。离线模式通常会在设置里说明。

小结提醒(不是总结)

总的来说,易翻译“取结果”的关键在于识别→预处理→翻译→渲染这条链路上每一步的质量与协同。用户看到的“最终译文”往往是模型与工程技巧共同调优的结果,遇到不理想的时候,多看看候选、多检查识别结果、或者提交反馈,效果会好很多。技术上还有很多细节可以进一步钻研(比如Beam Search、子词分割、流式解码等),需要再深入的话我们可以一步步拆开来讲——现在就先写到这儿,随时可以接着聊具体场景或某个技术点(比如ASR的噪声鲁棒性或OCR排版处理)。