易翻译反应慢,往往不是单一故障,而是网络、服务器与本地设备三方面叠加造成的:从请求发出到结果显示,要经过网络往返、服务端排队与模型推理、再到客户端解码和界面刷新。短时卡顿多与网络或接口限流相关,长期变慢则可能涉及模型推理瓶颈、冷启动、资源争用或软件实现缺陷。排查时同时看网络、版本、配置与样本复现,能最快定位问题并采取针对性优化。

先把事情讲清楚:慢是怎样“慢”的?

我们先把“慢”拆成几类,像把一杯混着各种调料的汤分层看,只有分清每层味道,才能对症下药。

1. 感知延迟(界面卡顿)

用户点了“翻译”,界面不响应或按钮晃一下就没反应,这通常是前端阻塞、主线程被耗时操作占用、或动画/渲染被系统节流。

2. 请求-响应延迟(网络往返时间)

从设备发出请求到服务器返回结果的时间。包含DNS解析、TCP/TLS握手、数据传输与服务端处理时间。若用户在海外或用移动网络,这一项会明显拉长。

3. 服务端等待(排队/限流)

高并发时请求被放入队列,或被API网关限流、或等待模型资源(GPU/CPU)调度,表现为高延迟或请求超时。

4. 模型推理时间

核心翻译/ASR/OCR模型从接收输入到生成输出的时间。这与模型大小、并发策略、batching、硬件(GPU/CPU/TPU)有关。

5. 后处理与客户端解码

服务端返回文本或语音,客户端要做文本渲染、语音合成、或者图像标注,这些步骤也会消耗可感知时间。

为什么这些环节会变慢?——把每一环节讲明白

用费曼法说话:像给不懂的人解释一样,举例子、列清单、说清楚“为什么”。下面把常见原因一条条说明。

网络问题:最常见也最容易被忽略

- 移动网络波动:基站切换、信号弱会使丢包、重传多,RTT(往返时延)飙升。

- 高链路RTT:跨境访问、长路径路由、国际链路拥塞会让一次请求多了几百毫秒甚至几秒。

- DNS/TLS冷启动:第一次访问或域名缓存过期会增加额外延迟。

- CDN/边缘缺失:若翻译服务未覆盖用户区域,资源每次都走回源站。

服务端压力与架构因素

- 并发超载:瞬时流量激增时,排队和降级策略会让延迟上升。

- 资源调度:GPU/TPU稀缺,服务可能做队列或轮询,延迟变得不可预测。

- 冷启动问题:无状态服务启动慢、容器或函数计算冷启动导致首个请求特别慢。

- 不合理批处理:为了吞吐量做batch会牺牲单次请求延迟。

模型与算法带来的固有开销

深度模型(尤其多语种、大规模翻译模型)在推理时需要大量计算。两条常见做法的权衡:

- *更大模型,翻译质量高但推理慢;*

- *更小模型,推理快但可能牺牲部分质量。*

客户端(手机/浏览器)因素

- 设备算力与内存:老机型做语音识别或合成时,可能把主线程拖慢。

- 系统省电策略:后台限频、网络节流会影响实时翻译。

- 应用实现问题:阻塞主线程的同步调用、重复请求、内存泄漏都会使体验变差。

- 权限或输入问题:麦克风权限被拒、音频采样率异常会强制重新协商或降级处理。

举个生活化的例子(把复杂事情简单化)

想象去餐厅点一道现做的菜:

- 你叫了服务员(网络请求);

- 服务员跑去厨房(路由往返);

- 厨师排队、找食材、开始做菜(服务端排队与模型推理);

- 做完后端上桌(响应返回),你再切分装盘(客户端渲染)。

如果厨房人手不足或食材要等、路途很远或服务员懒,就会变慢。要解决就要同时优化餐厅管理、厨师效率和你自己的点餐习惯。

用户能做什么:12条可立刻尝试的排查与加速方法

这些方法按“容易程度”排列,先试前几个,能立刻见效的往往是网络与设置层面的。

- 切换网络:从移动数据切到稳定Wi‑Fi,或反之试试。

- 测试延迟:用Speedtest或ping目标域名,看RTT和丢包。

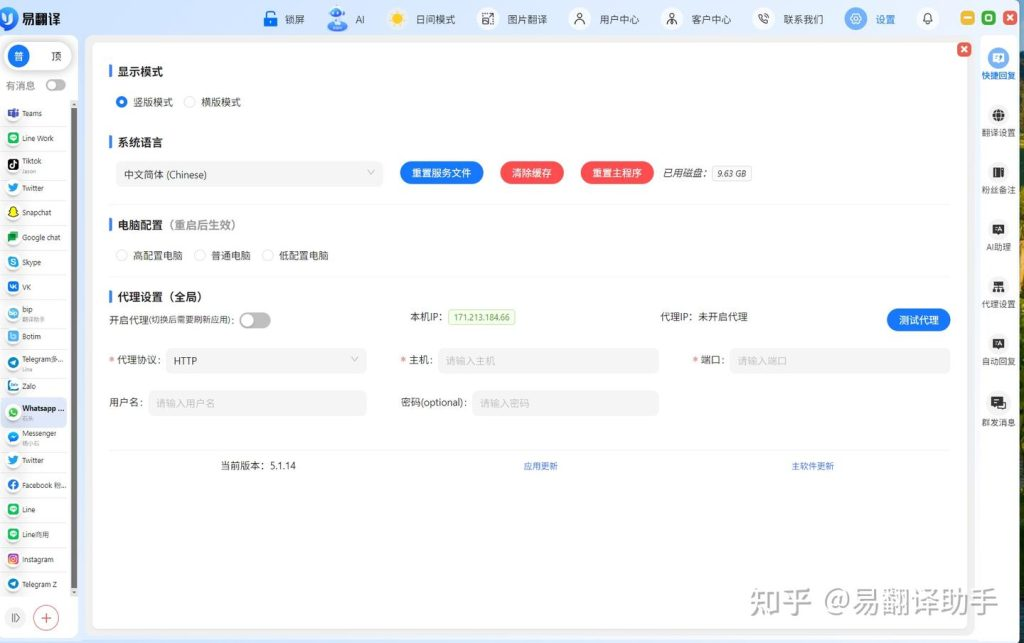

- 关闭省电/后台限制:关闭系统或应用的节能模式,允许后台运行。

- 更新应用:新版常包含性能修复。

- 清理缓存或重启应用:内存碎片或临时文件有时会影响速度。

- 降低输入复杂度:拍照时压缩图片或裁剪关键区域,语音用短句而非长录音。

- 允许必要权限:麦克风/相机权限缺失可能触发二次协商。

- 选择离线包:若支持本地离线模型,可在设置中开启以减少网络往返。

- 重启设备:释放被占用的内存与CPU。

- 尝试其他时间:高峰期(节假日或上下班)网络与服务器压力更大。

- 反馈样本:把慢的请求时间、操作步骤、设备型号提交给客服,方便复现。

- 看系统日志(稍高级):Android可用adb logcat,iOS查看Console,定位前端问题。

开发者和运维能做的技术优化(更细、更专业)

这里像给厨房升级:既有硬件也有流程优化,还有算法层面的改进。

架构与运维层面

- 部署边缘/多区域:把服务部署到靠近用户的区域或使用边缘推理,减少RTT。

- 合理自动弹性伸缩:根据延迟和队列长度自动扩容,而不是只根据CPU。

- 预热与冷启动优化:维持热实例池或使用延迟敏感的容器保活策略。

- 使用CDN与缓存:对静态资源(语音合成模型、小语言包)做缓存。

- 限流与降级:对非关键功能做优先级划分,保证核心请求低延迟。

模型与推理优化

- 模型蒸馏/量化/剪枝:用小模型近似大模型,减少推理时间与内存占用。

- 选择低延迟推理框架:TFLite、ONNX Runtime、TensorRT等针对推理优化。

- 混合推理:把通用翻译放在云端,常用短语或常见语言对放在边缘或设备端。

- 流式输出:语音或长句翻译采用流式推理,边译边显,不必等待整句完成。

客户端实现细节

- 异步与线程池:避免在主线程做阻塞调用,使用异步回调和合理线程池。

- 本地预处理:本地做音频去噪、VAD(语音活动检测),减少上传大小与重传概率。

- 渐进式渲染:先显示部分结果(候选翻译),随后补全,提升感知速度。

- 合理重试与退避:遇到短期网络问题,用指数退避避免加剧压力。

具体数值示例:把延迟“量化”更直观

我们把请求拆成几段来估算:

- 网络往返(手机到最近边缘):50–200 ms(良好到一般)

- 服务端排队与调度:0–500 ms(轻载到高峰)

- 模型推理(小模型/大模型):20–5000 ms

- 返回与客户端渲染:20–200 ms

把这些相加,理想情况可能在100–300 ms,现实中常见的延迟在500 ms–几秒;遇到大模型或跨境访问时,可能高达数秒甚至十几秒。这就是感受差异大的原因。

诊断清单:一步步定位问题(给客服或开发的实用流程)

- 复现场景:明确时间、操作步骤、语种、输入样例;尽可能录制视频或抓包。

- 测量网络:ping、traceroute、speedtest,记录RTT、丢包率。

- 检查客户端日志:崩溃、主线程堵塞、超时信息。

- 服务端链路追踪:通过分布式追踪(如Zipkin/Jaeger)查看每段耗时。

- 模型耗时剖析:单次推理耗时、批次等待时间、GPU/CPU利用率。

- 针对性优化并回归验证。

一个小表格:常见原因与对应快速修复建议

| 原因 | 用户层快速修复 | 开发/运维持续优化 |

| 网络差/丢包 | 切换网络,重连Wi‑Fi,避开高峰 | 边缘部署、重传与丢包恢复、流控优化 |

| 模型推理慢 | 使用离线小模型或选择低质量模式 | 量化/蒸馏、异构设备推理、流式响应 |

| 客户端阻塞 | 更新App、重启设备、关闭省电 | 异步架构、主线程保护、内存泄漏修复 |

| 服务端排队/限流 | 避开高峰,提交更简短请求 | 动态扩容、优先级队列、降级策略 |

常见误解——顺便说一下

- “换台手机就能解决所有慢的问题”:有时有效,但如果问题在服务器或国际链路,换手机帮不了太多。

- “大模型一定比小模型慢很多”:通常是,但通过高效推理框架与硬件加速,小模型与优化后大模型的差异可以被缩小。

- “在线一定比离线慢”:在线能用更强的模型、更多语种,但网络不稳时离线反而更快、稳定。

最后几句像边想边写的感受(别太正式)

说白了,翻译应用慢,像家里网络突然卡顿,可能是路由器也可能是网线坏了,也可能是整个小区网闹钟同时刷短视频——要把每一环节都看看。作为用户,先从网络和设置入手;作为开发者,要把“感知延迟”当成第一优先,分层优化。平常多留点使用场景的反馈,问题往往就能更快被复现和修好——我也遇到过下午高峰时语音翻译一卡一顿,最后发现只是边缘节点被流量挤爆了,换了个区域就好了。这些都是实操经验,希望对你排查易翻译慢的问题有用。